El Metaverso ya tiene el primer problema

|

| Getty Images |

Una mujer fue acosada sexualmente en la plataforma de redes sociales VR de Meta. Ella no es la primera y no será la última.

Por Tanya Basu

Dic 16, 2021. La semana pasada, Meta (la compañía paraguas antes conocida como Facebook) abrió el acceso a su plataforma de redes sociales de realidad virtual, Horizon Worlds. Las primeras descripciones de la plataforma hacen que parezca divertido y saludable, lo que hace que se comparen con Minecraft. En Horizon Worlds, se pueden reunir hasta 20 avatares a la vez para explorar, pasar el rato y construir dentro del espacio virtual.

Pero no todo ha sido cálido y difuso. Según Meta, el 26 de noviembre, una beta tester informó algo profundamente preocupante: un extraño la había manoseado en Horizon Worlds. El 1 de diciembre, Meta reveló que había publicado su experiencia en el grupo de pruebas beta de Horizon Worlds en Facebook.

La revisión interna de Meta del incidente encontró que el probador beta debería haber usado una herramienta llamada "Safe Zone" que es parte de un conjunto de características de seguridad integradas en Horizon Worlds. Safe Zone es una burbuja protectora que los usuarios pueden activar cuando se sienten amenazados. Dentro de él, nadie puede tocarlos, hablar con ellos o interactuar de ninguna manera hasta que indiquen que les gustaría que se levante la Zona Segura.

Vivek Sharma, el vicepresidente de Horizon, calificó el incidente de manoseo como "absolutamente desafortunado", y le dijo a The Verge: "Eso es un buen comentario para nosotros porque quiero que [la función de bloqueo] sea trivialmente fácil y fácil de encontrar".

No es la primera vez que se manosea a un usuario en la realidad virtual y, lamentablemente, tampoco será la última. Pero el incidente muestra que hasta que las empresas averigüen cómo proteger a los participantes, el metaverso nunca podrá ser un lugar seguro.

"Ahí estaba, siendo virtualmente manoseada"

Cuando Aaron Stanton se enteró del incidente en Meta, fue transportado a octubre de 2016. Fue entonces cuando un jugador, Jordan Belamire, escribió una carta abierta en Medium en la que describía que lo manoseaban en Quivr, un juego que Stanton co-diseñó en el que los jugadores, equipados con arco y flechas, dispara zombies.

En la carta, Belamire describió haber ingresado a un modo multijugador, donde todos los personajes eran exactamente iguales excepto por sus voces. “En medio de una ola de zombis y demonios para derribar, estaba pasando el rato junto a BigBro442, esperando nuestro próximo ataque. De repente, el casco incorpóreo de BigBro442 me enfrentó directamente. Su mano flotante se acercó a mi cuerpo y comenzó a frotar virtualmente mi pecho. "¡Detente!", Grité ... Esto lo aguijoneó, e incluso cuando me alejé de él, me persiguió, haciendo movimientos de agarrar y pellizcar cerca de mi pecho. Envalentonado, incluso empujó su mano hacia mi entrepierna virtual y comenzó a frotar.

“Ahí estaba yo, virtualmente manoseada en una fortaleza nevada con mi cuñado y mi esposo mirando”.

Stanton y su cofundador, Jonathan Schenker, respondieron de inmediato con una disculpa y una solución en el juego. Los avatares podrían estirar los brazos en un gesto de V, lo que automáticamente alejaría a los delincuentes.

Stanton, quien hoy dirige el Instituto de RV para la Salud y el Ejercicio, dice que Quivr no hizo un seguimiento de los datos sobre esa función, "ni creo que se usó mucho". Pero Stanton piensa en Belamire a menudo y se pregunta si podría haber hecho más en 2016 para evitar el incidente que ocurrió en Horizon Worlds hace unas semanas. "Hay mucho más por hacer aquí", dice. "Nadie debería tener que huir de una experiencia de realidad virtual para evitar sentirse impotente".

El acoso sexual en realidad virtual es acoso sexual, y punto final

Una revisión reciente de los eventos en torno a la experiencia de Belamire publicada en la revista de la Asociación de Investigación de Juegos Digitales encontró que “muchas respuestas en línea a este incidente desestimaron la experiencia de Belamire y, en ocasiones, fueron abusivas y misóginas ... lectores de todas las perspectivas lucharon por comprender este acto dado el contexto virtual y lúdico en el que ocurrió ". Belamire desapareció de la vista y no pude encontrarla en línea.

Un tema constante de debate en los foros de mensajes después del artículo de Belamire en Medium era si lo que había experimentado era en realidad manosear si su cuerpo no había sido tocado físicamente.

"Creo que la gente debe tener en cuenta que el acoso sexual nunca ha tenido que ser algo físico", dice Jesse Fox, profesor asociado de la Universidad Estatal de Ohio que investiga las implicaciones sociales de la realidad virtual. “Puede ser verbal y sí, también puede ser una experiencia virtual.

Katherine Cross, quien investiga el acoso en línea en la Universidad de Washington, dice que cuando la realidad virtual es inmersiva y real, el comportamiento tóxico que ocurre en ese entorno también es real. “Al final del día, la naturaleza de los espacios de realidad virtual es tal que está diseñada para engañar al usuario haciéndole creer que está físicamente en un espacio determinado, que todas sus acciones corporales ocurren en un entorno 3D”, ella dice. "Es parte de la razón por la que las reacciones emocionales pueden ser más fuertes en ese espacio y por qué la realidad virtual desencadena el mismo sistema nervioso interno y respuestas psicológicas".

Eso fue cierto en el caso de la mujer que fue manoseada en Horizon Worlds. Según The Verge, su publicación decía: “El acoso sexual no es una broma en Internet, pero estar en realidad virtual agrega otra capa que hace que el evento sea más intenso. No solo me manosearon anoche, sino que hubo otras personas que apoyaron este comportamiento que me hizo sentir aislada en la Plaza [el espacio de reunión central del entorno virtual] ".

La agresión y el acoso sexual en los mundos virtuales no es nuevo, ni es realista esperar un mundo en el que estos problemas desaparezcan por completo. Mientras haya personas que se escondan detrás de las pantallas de sus computadoras para evadir la responsabilidad moral, seguirán ocurriendo.

El verdadero problema, quizás, tiene que ver con la percepción de que cuando juegas un juego o participas en un mundo virtual, existe lo que Stanton describe como un "contrato entre desarrollador y jugador". "Como jugador, acepto poder hacer lo que quiero en el mundo de los desarrolladores de acuerdo con sus reglas", dice. "Pero tan pronto como se rompe ese contrato y ya no me siento cómodo, la obligación de la empresa es devolver al jugador a donde quiera estar y volver a sentirse cómodo".

La pregunta es: ¿De quién es la responsabilidad de asegurarse de que los usuarios se sientan cómodos? Meta, por ejemplo, dice que les da a los usuarios acceso a herramientas para mantenerse seguros, transfiriendo efectivamente la responsabilidad a ellos.

"Queremos que todos en Horizon Worlds tengan una experiencia positiva con las herramientas de seguridad que son fáciles de encontrar, y nunca es culpa del usuario si no usan todas las funciones que ofrecemos", dijo la portavoz de Meta, Kristina Milian. “Continuaremos mejorando nuestra interfaz de usuario y para comprender mejor cómo las personas usan nuestras herramientas para que los usuarios puedan informar cosas de manera fácil y confiable. Nuestro objetivo es hacer que Horizon Worlds sea seguro y estamos comprometidos a hacer ese trabajo ".

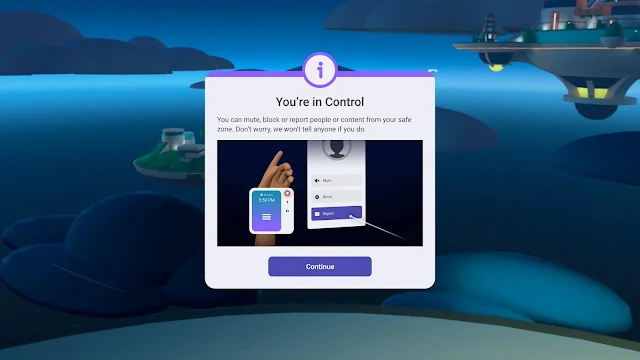

Milian dijo que los usuarios deben someterse a un proceso de incorporación antes de unirse a Horizon Worlds que les enseña cómo iniciar Safe Zone. También dijo que los recordatorios regulares se cargan en pantallas y carteles dentro de Horizon Worlds.

|

| Capturas de pantalla de la interfaz Safe Zone cortesía de Meta / FACEBOOK |

Pero el hecho de que la víctima de Meta a tientas no pensó en usar Safe Zone o no pudo acceder es precisamente el problema, dice Cross. "La cuestión estructural es el gran problema para mí", dice. "En términos generales, cuando las empresas abordan el abuso en línea, su solución es subcontratarlo al usuario y decirle: 'Aquí, le damos el poder para que se cuide'".

Y eso es injusto y no funciona. La seguridad debe ser fácil y accesible, y hay muchas ideas para hacer esto posible. Para Stanton, todo lo que se necesitaría es algún tipo de señal universal en la realidad virtual, tal vez el gesto V de Quivr, que pudiera transmitir a los moderadores que algo andaba mal. Fox se pregunta si una distancia personal automática, a menos que dos personas acuerden mutuamente estar más cerca, ayudaría. Y Cross cree que sería útil que las sesiones de capacitación establezcan explícitamente normas que reflejen las que prevalecen en la vida cotidiana: "En el mundo real, no tocarías a alguien al azar y deberías trasladarlo al mundo virtual".

Hasta que averigüemos de quién es el trabajo de proteger a los usuarios, un paso importante hacia un mundo virtual más seguro, debemos disciplinar a los agresores, que a menudo quedan libres de culpa y siguen siendo elegibles para participar en línea, incluso después de que se conozca su comportamiento. "Necesitamos elementos de disuasión", dice Fox. Eso significa asegurarse de que los malos actores sean encontrados y suspendidos o prohibidos. (Milian dijo que Meta "[no] comparte detalles sobre casos individuales" cuando se le preguntó qué le sucedió al presunto manoseador).

Stanton lamenta no haber presionado más para que toda la industria adopte el gesto de poder, y no haber hablado más sobre el incidente de manoseo de Belamire. “Fue una oportunidad perdida”, dice. "Podríamos haber evitado ese incidente en Meta".

Si algo está claro, es esto: no hay ningún organismo que sea claramente responsable de los derechos y la seguridad de quienes participan en cualquier lugar en línea, y mucho menos en los mundos virtuales. Hasta que algo cambie, el metaverso seguirá siendo un espacio peligroso y problemático.

El artículo original se puede leer en inglés en MIT Technology Review

El artículo ha sido traducido por L. Domenech

Comentarios

Publicar un comentario